要約

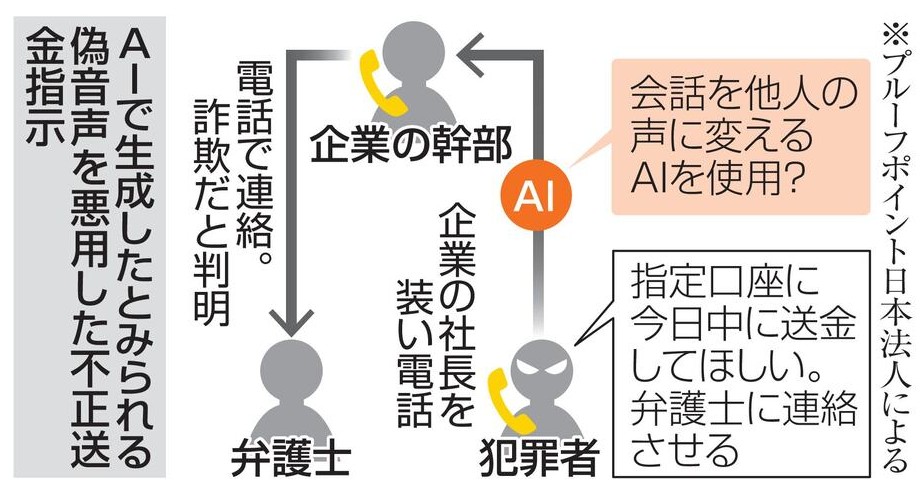

AIで生成した偽の音声を使い、社長になりすまして部下に不正送金を命じる詐欺事件が日本企業で発生しました。詐欺師は3回にわたって企業の幹部に電話をかけ、「緊急の企業買収がある」として送金を急がせました。声は社長そっくりで、電話番号も本物と同じに偽装されていたため、幹部はすぐに気づけませんでした。AI技術の進化により、こうした詐欺が増加する可能性があると専門家は警鐘を鳴らしています。

ミホとケンの対話

ミホ、AIが社長の声を偽装したってニュース見たけど、どういうこと?

簡単に言うと、AIを使って本物そっくりの声を作って、社長になりすました詐欺が起きたの!

えっ、そんなことできるの?まるでSF映画みたい!

ほんとにね。詐欺師は社長の声をAIで作って、部下に電話して送金を指示したの

でもさ、普通の部下なら怪しむんじゃない?

それがね、電話番号まで本物みたいに偽装されてたから、信じちゃったみたい

怖っ!どうやってそんな偽装できるの?

社長の声は動画サイトとかにアップされてることがあるでしょ?それをAIに学習させるんだって

じゃあ、有名人とかも狙われるかも?

その可能性もあるよ!実際、詐欺以外にもAIで有名人の偽動画が作られることもあるし

やばいじゃん!どうすれば防げるの?

例えば、急に送金を頼まれたら、別の方法で本人に確認するとか!

確かに!メールとか、直接話すとかだね

そう!企業も新しい対策を考えないと、こういう被害が増えるかも

AIって便利だけど、悪用されると大変なことになるんだな…

そうなの。だから技術が進化するほど、対策も必要になってくるの。

さらに詳しく

AIの発展によって、音声を本物そっくりに合成できる技術が登場しました。この技術は便利な一方で、詐欺などに悪用されるリスクも高まっています。今回の事件では、詐欺師が企業の社長の音声をAIで再現し、部下に電話をかけて送金を命じました。電話番号も本物のように偽装されていたため、部下は疑わずに指示に従いそうになりました。

このようなAIを使った詐欺は「ディープフェイク詐欺」とも呼ばれ、世界中で問題になっています。すでに海外では、大企業が数億円を騙し取られたケースも報告されています。こうした詐欺を防ぐためには、社員教育の強化や、不審な指示には必ず別の方法で本人確認を行うルールを徹底することが重要です。

また、AIの悪用は音声だけにとどまりません。動画や画像を偽装し、政治家や有名人の偽映像を作り出す技術も進化しています。これにより、フェイクニュースが広がりやすくなり、社会的な混乱を引き起こす可能性もあります。

専門家は、「AI技術の発展を止めることはできないが、それを安全に使うための法律や対策が必要」と指摘しています。個人でも、安易に信じ込まず、情報を慎重に確認する意識を持つことが大切です。

まとめ

AIで生成された偽の音声を使った詐欺事件が日本で発生しました。詐欺師は、社長の声をAIで再現し、部下に不正送金を命じました。電話番号まで偽装されていたため、すぐには見抜けませんでした。このような詐欺は今後増える可能性があり、企業や個人は対策を強化する必要があります。本人確認の徹底や、不審な指示には慎重に対応することが重要です。

コメント